Машины обрели внутренний голос. Последняя грань между искусственным и живым — уничтожена

NewsMakerСледующий шаг — заговоры без нашего участия?

Компания DeepMind , принадлежащая Google, разрабатывает новую технологию для роботов и искусственного интеллекта, которая может заметно ускорить и упростить обучение машин. Речь идет о системе внутреннего монолога, позволяющей ИИ-агентам сопровождать свое восприятие окружающего мира естественным языковым описанием происходящего. Эта технология уже запатентована и может изменить принципы обучения роботов.

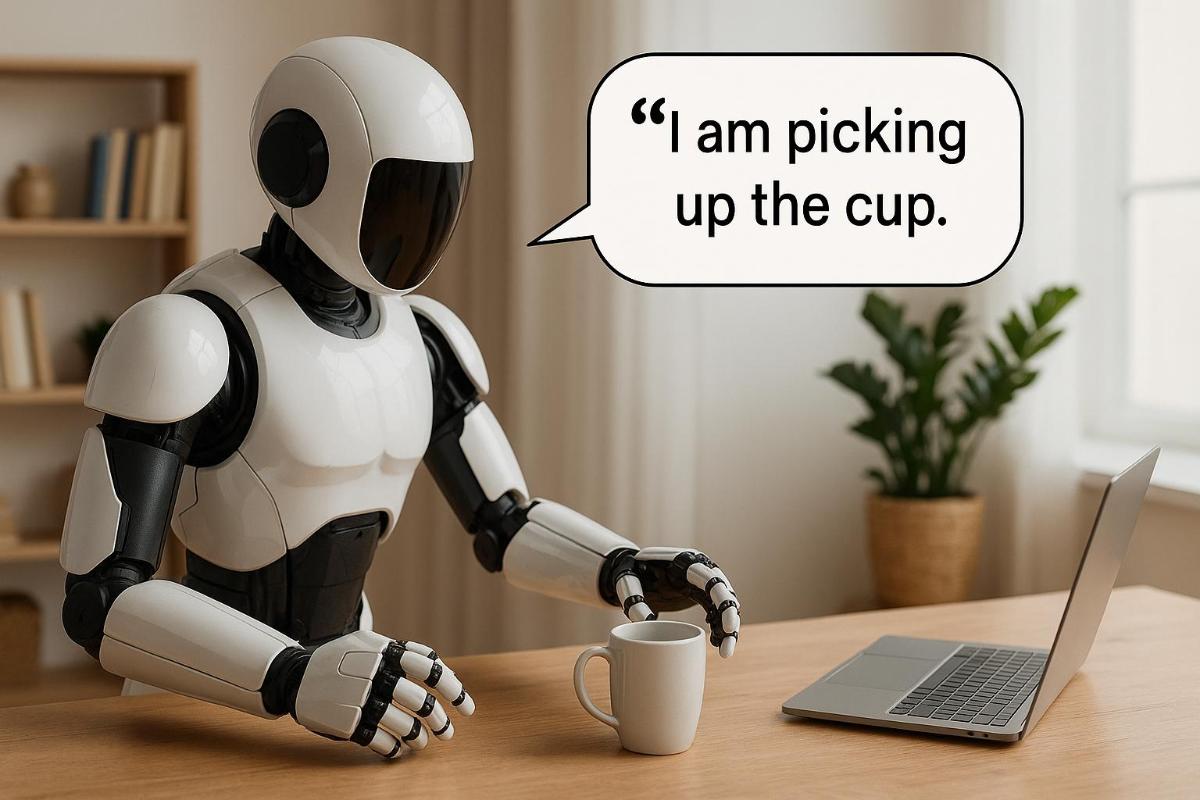

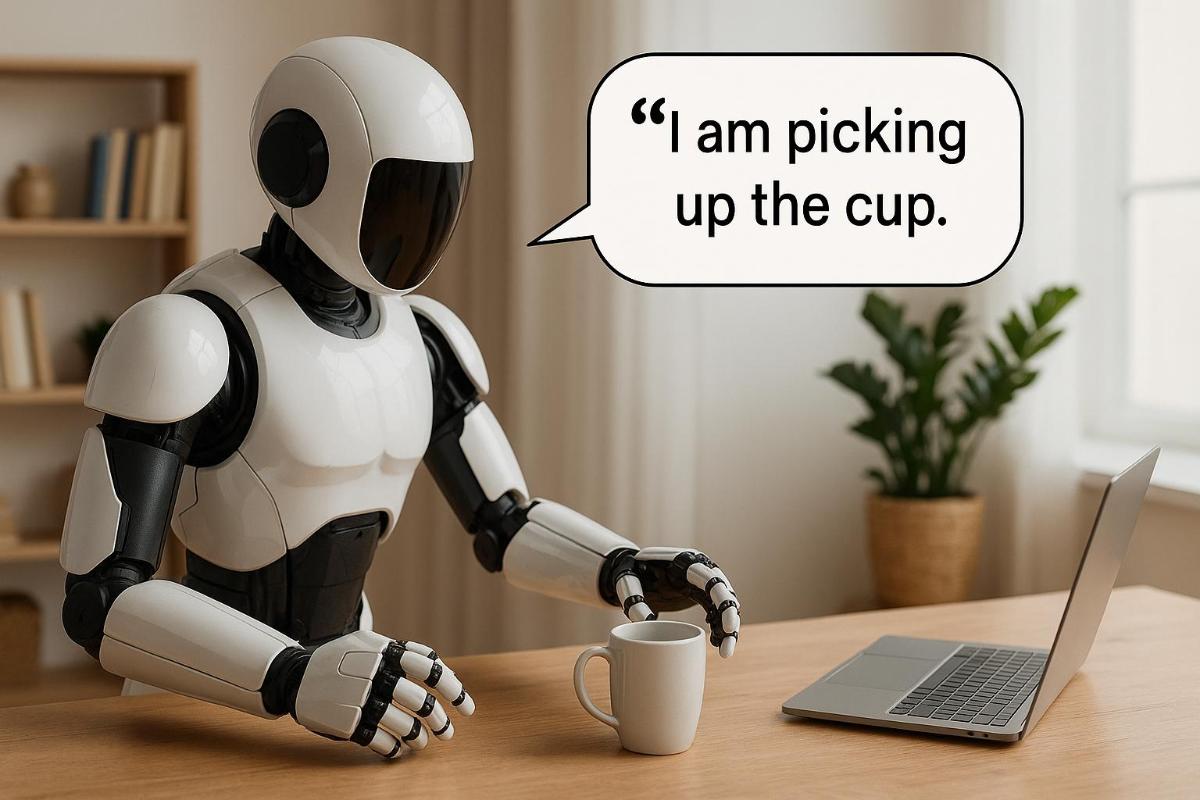

Метод, предложенный DeepMind, официально называется внутренняя речь агента для облегчения обучения задачам (intra-agent speech to facilitate task learning). Суть подхода заключается в том, что робот или программный ИИ-агент наблюдает за выполнением какой-либо задачи — например, через видео или изображения — и параллельно проговаривает внутри себя, что он видит. Это своего рода мысленный комментарий: наблюдая за тем, как человек берет чашку, система формулирует фразу человек берет чашку.

Такая форма внутреннего описания помогает связать визуальные данные с конкретными действиями. Это не просто запоминание последовательности движений, а полноценное формирование причинно-следственных связей между наблюдаемым объектом и необходимым действием.

Одно из ключевых преимуществ этой технологии — так называемое обучение с нуля (zero-shot learning). Иными словами, робот сможет выполнять задачи, связанные с ранее незнакомыми предметами или ситуациями, без предварительной тренировки. В привычных системах ИИ обучение на новые объекты требует длительных циклов подготовки данных и вычислительных ресурсов. В данном случае, благодаря внутреннему монологу, система сама формирует языковое описание, что позволяет быстрее соотнести новое визуальное восприятие с подходящими действиями.

Кроме того, как подчеркивает DeepMind, метод снижает требования к памяти и вычислительным мощностям, что особенно важно для автономных или маломощных устройств.

Эта разработка вписывается в более широкие усилия компании по совершенствованию робототехники. Совсем недавно DeepMind представила систему под названием Gemini Robotics On-Device, рассчитанную на работу непосредственно на роботе — без необходимости постоянного подключения к облачным сервисам.

Gemini Robotics On-Device — это компактная версия уже известной модели Gemini Robotics, сочетающей визуальное восприятие и языковые способности. В отличие от стандартной облачной версии, эта модификация работает локально, прямо на устройстве. Такой подход особенно полезен там, где подключение к интернету нестабильно или нежелательно — например, в медицинских учреждениях, где важна конфиденциальность данных.

Несмотря на то, что локальная версия легче и компактнее, она демонстрирует впечатляющие результаты. По данным разработчиков DeepMind, модель способна выполнять задачи из коробки, а для обучения новым действиям ей достаточно 50–100 демонстраций. Это существенно ускоряет адаптацию под конкретного робота и конкретную задачу.

Первоначально модель обучалась на роботе ALOHA, принадлежащем Google, однако впоследствии ее адаптировали и для других платформ. Среди них — гуманоидный робот Apptronik Apollo и манипулятор Franka FR3. Система способна с высокой точностью и плавностью выполнять сложные действия, включая складывание одежды или расстегивание молний.

При необходимости разработчики могут дообучить модель, управляя роботом вручную — это называется телеприсутствием или телеоперацией. Такой гибкий подход позволяет быстро адаптировать ИИ к новым условиям.

DeepMind также предусмотрела возможность тестирования модели в симулированной среде, используя физический движок Multi-Joint dynamics with Contact, либо сразу внедрять ее в реальные роботы.

Однако стоит отметить, что локальная версия Gemini Robotics On-Device пока не оснащена встроенными системами семантической безопасности. В отличие от гибридных или облачных версий, здесь защита от некорректного или потенциально опасного поведения возлагается на разработчиков. DeepMind рекомендует внедрять собственные протоколы безопасности , а на текущем этапе доступа к системе предоставляется ограниченному числу пользователей для проверки рисков при эксплуатации в реальной среде.

Добавление внутренней речи дает роботам дополнительный контекст, позволяя им принимать более обоснованные решения и адаптироваться к незнакомым ситуациям. Это особенно важно для роботов, работающих в динамичных, непредсказуемых условиях, где не всегда возможно заранее подготовить весь набор данных для обучения.

Пока технологии находятся в стадии активного тестирования и совершенствования, но сама концепция внутреннего монолога может стать важным этапом на пути к более самостоятельным и гибким ИИ-системам.

Интересно, что на фоне этих событий DeepMind недавно анонсировала и другое значимое достижение : ИИ-модель, способную прогнозировать влияние конкретных мутаций ДНК на сложнейшие системы, регулирующие активность генов. Это еще один пример того, как лаборатория Google продвигает границы применения ИИ сразу в нескольких отраслях — от биологии до робототехники.

Компания DeepMind , принадлежащая Google, разрабатывает новую технологию для роботов и искусственного интеллекта, которая может заметно ускорить и упростить обучение машин. Речь идет о системе внутреннего монолога, позволяющей ИИ-агентам сопровождать свое восприятие окружающего мира естественным языковым описанием происходящего. Эта технология уже запатентована и может изменить принципы обучения роботов.

Метод, предложенный DeepMind, официально называется внутренняя речь агента для облегчения обучения задачам (intra-agent speech to facilitate task learning). Суть подхода заключается в том, что робот или программный ИИ-агент наблюдает за выполнением какой-либо задачи — например, через видео или изображения — и параллельно проговаривает внутри себя, что он видит. Это своего рода мысленный комментарий: наблюдая за тем, как человек берет чашку, система формулирует фразу человек берет чашку.

Такая форма внутреннего описания помогает связать визуальные данные с конкретными действиями. Это не просто запоминание последовательности движений, а полноценное формирование причинно-следственных связей между наблюдаемым объектом и необходимым действием.

Одно из ключевых преимуществ этой технологии — так называемое обучение с нуля (zero-shot learning). Иными словами, робот сможет выполнять задачи, связанные с ранее незнакомыми предметами или ситуациями, без предварительной тренировки. В привычных системах ИИ обучение на новые объекты требует длительных циклов подготовки данных и вычислительных ресурсов. В данном случае, благодаря внутреннему монологу, система сама формирует языковое описание, что позволяет быстрее соотнести новое визуальное восприятие с подходящими действиями.

Кроме того, как подчеркивает DeepMind, метод снижает требования к памяти и вычислительным мощностям, что особенно важно для автономных или маломощных устройств.

Эта разработка вписывается в более широкие усилия компании по совершенствованию робототехники. Совсем недавно DeepMind представила систему под названием Gemini Robotics On-Device, рассчитанную на работу непосредственно на роботе — без необходимости постоянного подключения к облачным сервисам.

Gemini Robotics On-Device — это компактная версия уже известной модели Gemini Robotics, сочетающей визуальное восприятие и языковые способности. В отличие от стандартной облачной версии, эта модификация работает локально, прямо на устройстве. Такой подход особенно полезен там, где подключение к интернету нестабильно или нежелательно — например, в медицинских учреждениях, где важна конфиденциальность данных.

Несмотря на то, что локальная версия легче и компактнее, она демонстрирует впечатляющие результаты. По данным разработчиков DeepMind, модель способна выполнять задачи из коробки, а для обучения новым действиям ей достаточно 50–100 демонстраций. Это существенно ускоряет адаптацию под конкретного робота и конкретную задачу.

Первоначально модель обучалась на роботе ALOHA, принадлежащем Google, однако впоследствии ее адаптировали и для других платформ. Среди них — гуманоидный робот Apptronik Apollo и манипулятор Franka FR3. Система способна с высокой точностью и плавностью выполнять сложные действия, включая складывание одежды или расстегивание молний.

При необходимости разработчики могут дообучить модель, управляя роботом вручную — это называется телеприсутствием или телеоперацией. Такой гибкий подход позволяет быстро адаптировать ИИ к новым условиям.

DeepMind также предусмотрела возможность тестирования модели в симулированной среде, используя физический движок Multi-Joint dynamics with Contact, либо сразу внедрять ее в реальные роботы.

Однако стоит отметить, что локальная версия Gemini Robotics On-Device пока не оснащена встроенными системами семантической безопасности. В отличие от гибридных или облачных версий, здесь защита от некорректного или потенциально опасного поведения возлагается на разработчиков. DeepMind рекомендует внедрять собственные протоколы безопасности , а на текущем этапе доступа к системе предоставляется ограниченному числу пользователей для проверки рисков при эксплуатации в реальной среде.

Добавление внутренней речи дает роботам дополнительный контекст, позволяя им принимать более обоснованные решения и адаптироваться к незнакомым ситуациям. Это особенно важно для роботов, работающих в динамичных, непредсказуемых условиях, где не всегда возможно заранее подготовить весь набор данных для обучения.

Пока технологии находятся в стадии активного тестирования и совершенствования, но сама концепция внутреннего монолога может стать важным этапом на пути к более самостоятельным и гибким ИИ-системам.

Интересно, что на фоне этих событий DeepMind недавно анонсировала и другое значимое достижение : ИИ-модель, способную прогнозировать влияние конкретных мутаций ДНК на сложнейшие системы, регулирующие активность генов. Это еще один пример того, как лаборатория Google продвигает границы применения ИИ сразу в нескольких отраслях — от биологии до робототехники.