Мёртвые ученые в TikTok собирают миллионы просмотров: «зловещая долина» — всего лишь миф?

NewsMakerОжившие Тесла, Кюри и другие разносят давнюю психологическую теорию.

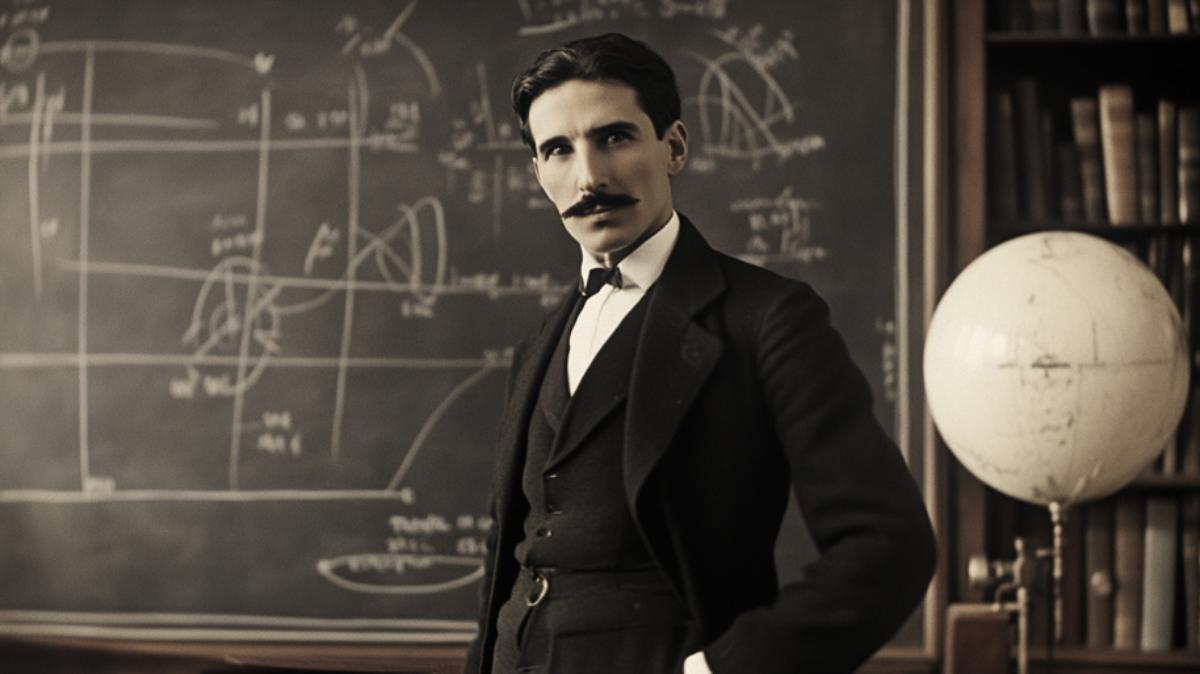

В TikTok стали распространяться любопытные ролики с цифровыми клонами известных ученых (вроде Марии Кюри и Николы Тесла), рассказывающими аудитории о физических законах простым языком. Конечно, за появлением реалистичных образов, собирающих миллионы просмотров, стоят новейшие технологии компьютерного моделирования. И мало кто задумывается, что использование электронных двойников в целях просвещения может привести к неожиданным психологическим последствиям. Так ли это? Действительно ли уловки с цифровыми учеными положительно влияют на публику?

Алгоритмы создания цифровых изображений и анимации совершенствуются с каждым днем: компьютеры учатся воспроизводить черты и движения человека всё точнее. Тем не менее даже самые правдоподобные аватары выдают себя: в движениях проскальзывают заминки, мимика выглядит неестественной, а речь не совпадает с движением губ. Незаметные на первый взгляд сбои в синхронизации, микрозадержки и неточности в выражении эмоций — все эти мелкие дефекты внимательный зритель улавливает моментально.

Малейшие отклонения от естественности вызывают у нас особую реакцию, которую в когнитивной науке называют "зловещей долиной". Японский ученый Масахиро Мори первым заметил: когда искусственный образ почти неотличим от человека, но содержит едва уловимые искажения, у наблюдателя возникает острый дискомфорт, близкий к отвращению. Любопытно, что простые мультяшные персонажи такого эффекта не производят — к ним относятся с симпатией.

Ученые из Центра передовых интернет-исследований (CAIS) в немецком Бохуме решили выяснить, как эффект "зловещей долины" влияет на восприятие образовательных материалов, созданных искусственным интеллектом. Ясмин Бааке с коллегами провели масштабное исследование: они хотели понять, насколько общество готово доверять информации от цифровых лекторов.

Но реальность оказалась иной. Зрители отдали предпочтение максимально реалистичным образам. После просмотра роликов участники оценивали три качества виртуальных лекторов: профессионализм, искренность и доброжелательность — характеристики, определяющие общий уровень доверия к источнику информации. По всем показателям человечные модели лидировали. Гендерные различия проявились лишь частично: мужским образам действительно приписали более высокую компетентность, но по остальным параметрам разницы не было.

Исследователи обеспечили полную прозрачность эксперимента: программный код виртуальных ведущих выложен в открытый доступ. Ученые могут исследовать каждый элемент анимации, каждый алгоритм генерации мимики и движений. Такой подход позволит независимым экспертам проверить, какие именно характеристики аватаров влияют на их восприятие аудиторией, и, возможно, внести свои предложения.

Углубленный анализ также показал: многое зависит и от самих зрителей, их знакомства с современными технологиями и общего доверия к науке.

Итак, фотореалистичные модели могут успешно доносить научные знания. Однако исследователи подчеркивают: необходимы дополнительные эксперименты с разными степенями реалистичности. Новые опыты помогут понять, не возникает ли отторжение на каких-то промежуточных этапах, а также прояснят, какую роль в этом процессе играют индивидуальные психологические особенности и опыт. Получается, популяризация науки выходит на принципиально новый уровень благодаря генеративному ИИ? И образование неизбежно трансформируется под влиянием новых технологий.

В TikTok стали распространяться любопытные ролики с цифровыми клонами известных ученых (вроде Марии Кюри и Николы Тесла), рассказывающими аудитории о физических законах простым языком. Конечно, за появлением реалистичных образов, собирающих миллионы просмотров, стоят новейшие технологии компьютерного моделирования. И мало кто задумывается, что использование электронных двойников в целях просвещения может привести к неожиданным психологическим последствиям. Так ли это? Действительно ли уловки с цифровыми учеными положительно влияют на публику?

Алгоритмы создания цифровых изображений и анимации совершенствуются с каждым днем: компьютеры учатся воспроизводить черты и движения человека всё точнее. Тем не менее даже самые правдоподобные аватары выдают себя: в движениях проскальзывают заминки, мимика выглядит неестественной, а речь не совпадает с движением губ. Незаметные на первый взгляд сбои в синхронизации, микрозадержки и неточности в выражении эмоций — все эти мелкие дефекты внимательный зритель улавливает моментально.

Малейшие отклонения от естественности вызывают у нас особую реакцию, которую в когнитивной науке называют "зловещей долиной". Японский ученый Масахиро Мори первым заметил: когда искусственный образ почти неотличим от человека, но содержит едва уловимые искажения, у наблюдателя возникает острый дискомфорт, близкий к отвращению. Любопытно, что простые мультяшные персонажи такого эффекта не производят — к ним относятся с симпатией.

Ученые из Центра передовых интернет-исследований (CAIS) в немецком Бохуме решили выяснить, как эффект "зловещей долины" влияет на восприятие образовательных материалов, созданных искусственным интеллектом. Ясмин Бааке с коллегами провели масштабное исследование: они хотели понять, насколько общество готово доверять информации от цифровых лекторов.

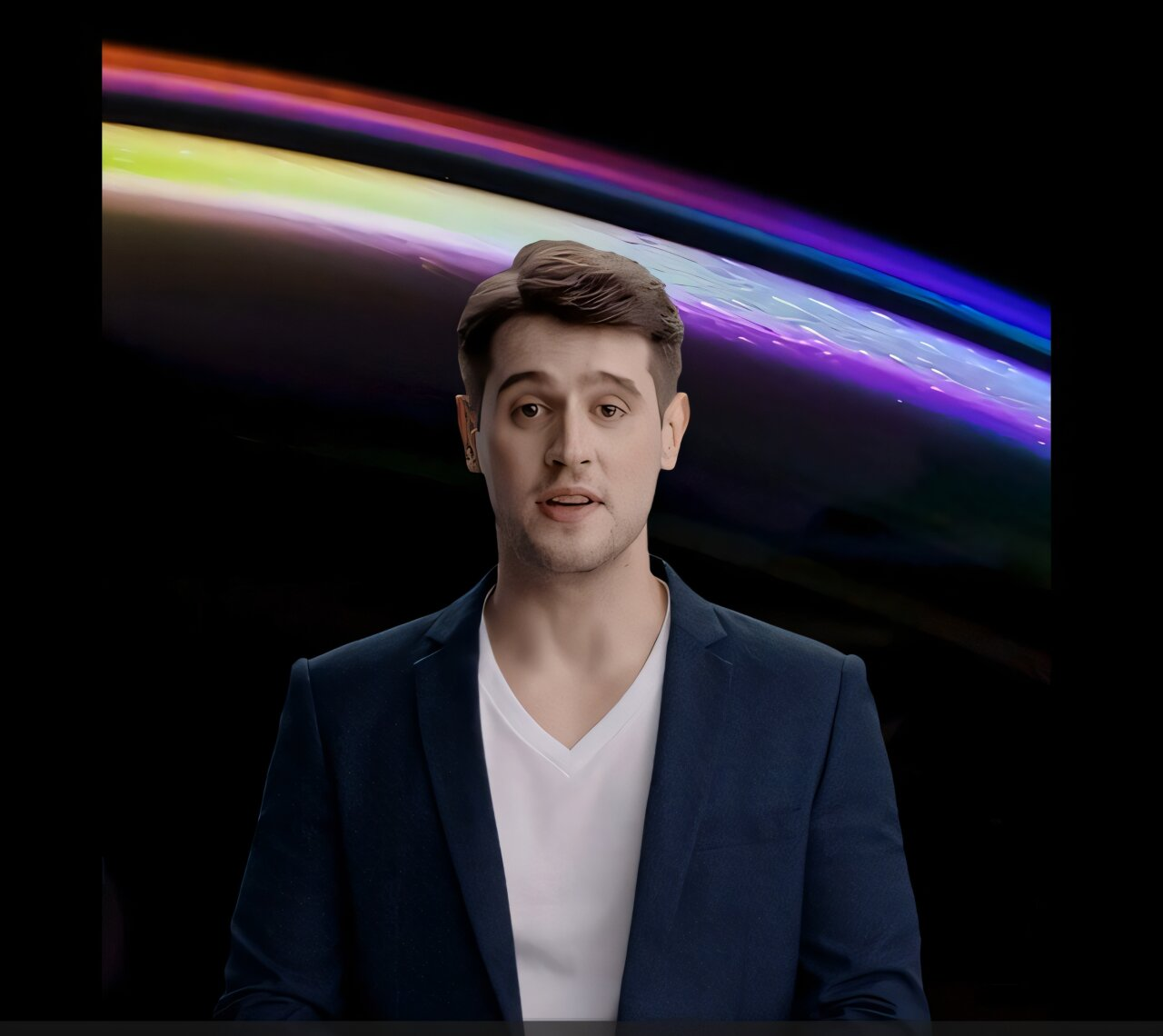

Нас интересовало, как люди воспринимают виртуальных ведущих. Особенно важно было узнать, какую роль в формировании доверия играет их внешность — насколько правдоподобно они смотрятся и какого они пола, — рассказывает Бааке.Для эксперимента создали серию роликов с четырьмя разными ведущими. Дикторы отличались по двум параметрам: одни выглядели как настоящие люди, другие напоминали мультипликационных персонажей, при этом были представлены и мужские, и женские образы. К участию пригласили 500 добровольцев — тщательно отобранный срез немецкого общества по возрасту, полу и образованию.

Говоря о степени реализма, мы, основываясь на гипотезе зловещей долины, предполагали, что мультяшные персонажи вызовут больше доверия, — поясняет Бааке. — В научной литературе хорошо описано, что мужчин-ученых обычно считают более компетентными. Мы опасались, что аватары, созданные нейросетью, могут не только отразить, но и усилить эти стереотипы из-за предвзятости в обучающих данных.

Но реальность оказалась иной. Зрители отдали предпочтение максимально реалистичным образам. После просмотра роликов участники оценивали три качества виртуальных лекторов: профессионализм, искренность и доброжелательность — характеристики, определяющие общий уровень доверия к источнику информации. По всем показателям человечные модели лидировали. Гендерные различия проявились лишь частично: мужским образам действительно приписали более высокую компетентность, но по остальным параметрам разницы не было.

Исследователи обеспечили полную прозрачность эксперимента: программный код виртуальных ведущих выложен в открытый доступ. Ученые могут исследовать каждый элемент анимации, каждый алгоритм генерации мимики и движений. Такой подход позволит независимым экспертам проверить, какие именно характеристики аватаров влияют на их восприятие аудиторией, и, возможно, внести свои предложения.

Углубленный анализ также показал: многое зависит и от самих зрителей, их знакомства с современными технологиями и общего доверия к науке.

Итак, фотореалистичные модели могут успешно доносить научные знания. Однако исследователи подчеркивают: необходимы дополнительные эксперименты с разными степенями реалистичности. Новые опыты помогут понять, не возникает ли отторжение на каких-то промежуточных этапах, а также прояснят, какую роль в этом процессе играют индивидуальные психологические особенности и опыт. Получается, популяризация науки выходит на принципиально новый уровень благодаря генеративному ИИ? И образование неизбежно трансформируется под влиянием новых технологий.